Seit gestern besitze ich einen Jetson Orin 64GB. Als erstes habe ich mal getestet, wie gut die Performance der GPU ist. Dafür habe erst mal Tensorflow 2.9.1 mit GPU-Unterstützung installiert und einen Benchmark laufen lassen, den ich hier kopiert habe. Hier das Benchmark Skript das ich für meinen Test genutzt habe. Die folgenden System habe ich miteinander verglichen. Jetson Orin 64GB – Mode = MAX entry { name: „TensorFlowBenchmark.run_op_benchmark“ iters: 10 wall_time: 0.003049612045288086 extras { key: „allocator_maximum_num_bytes_GPU_0_bfc“ value { double_value: 12582912.0 } } extras { key: „allocator_maximum_num_bytes_gpu_host_bfc“ value { double_value: 8.0 } } } Google Colab T4 GPU entry { name: „TensorFlowBenchmark.run_op_benchmark“ iters: 10 wall_time: 0.001888871192932129 extras { key: „allocator_maximum_num_bytes_GPU_0_bfc“ value { double_value: 12582912.0 } } extras { key: „allocator_maximum_num_bytes_gpu_host_bfc“…

Kommentare sind geschlossenjentsch.io Beiträge

Unter https://www.learndatasci.com/books/ gibt es eine umfangreiche Sammlung von über 100 kostenlosen Büchern zu den verschiedensten Aspekten der Datenwissenschaft. Egal, ob es um Data Science, Big Data, Datenvisualisierung, Data-Mining, maschinelles Lernen, Python, R oder anderen relevanten Themen geht – auf dieser Webseite wird man fündig!

Kommentare sind geschlossenChatGPT kann komplexe und umfangreiche Antworten auf eine Vielzahl von Fragen generieren und hat das Potenzial, die Art und Weise, wie wir mit Computern und anderen Technologien (z.B. Robotern) interagieren, zu verändern. Aber wie abhängig sind wir schon heute von ChatGPT, Midjourney und anderen generativen KIs? Naja, es kommt darauf an. ChatGPT ist ein Werkzeug, das uns helfen kann, schneller und effizienter zu arbeiten. Es kann dabei helfen, Antworten auf Fragen zu finden, oder bei der Erledigung von Aufgaben unterstützen. Mittelfristig besteht allerdings die Gefahr, dass wir uns zu sehr darauf verlassen und unsere Fähigkeiten zur Lösung von Problemen ohne die Unterstützung von ChatGPT und Co. verlieren. Daher ist es wichtig, daran zu denken, dass ChatGPT nur ein Werkzeug ist…

Kommentare sind geschlossenIn einem Talk redet Prof. Nadav Cohen an der Tel Aviv University’s Blavatnik School of Computer Science mit Sam Altman, dem CEO von OpenAI, und dem Mitbegründer und Chefwissenschaftler des Unternehmens, Ilya Sutskever. Ab ca. Minute 21 geht es dann um dann um das Thema Klimaschutz und ich bin etwas irritiert. Tel Aviv University Sam Altman and Ilya Sutskever Transcript Auszug des Talk ab ca. Minute 21. Sam Altman:I think once we have a really powerful super intelligence addressing climate change will not be particularly difficult for a system like that. Ilya Sutskever:We can even explain how. Here’s how you solve climate change. You need a very large amount of efficient carbon capture, you need the energy for the carbon…

Kommentare sind geschlossenEin Tokenizer ist eine Komponente von Large Language Models (LLMs) die dazu dient, einen Text in Token zu zerlegen (encoding) und die Token wieder in einen lesbaren Text umzuwandeln (decoding). Ohne einen Tokenizer ist die Verarbeitung von natürlicher Sprache in den aktuell verfügbaren LLMs nicht möglich, da sie nur Token verarbeiten können. Das grundlegende Konzept des Tokenizers besteht darin, einen Text in kleinere Einheiten zu zerlegen und in Zahlen umzuwandeln. Anstatt den gesamten Text als eine zusammenhängende Zeichenkette zu betrachten, wird er in kleine Einheiten wie Wörter, Subwörter oder sogar einzelne Zeichen unterteilt. Dieser Prozess ermöglicht es dem LLM, die verschiedenen Bestandteile eines Textes besser zu verstehen und in Beziehung zueinander zu setzen. Statt Wörter als Einheiten zu betrachten, werden…

Kommentare sind geschlossenIn dem YouTube Video „Der einzige Prompt, den Du kennen musst.“ wird ein ChatGPT Prompt gezeigt. mit dem es möglich ist, ein Frage-Antwort Dialog mit ChatGPT zu führen, um einen möglichst guten Prompt für eine bestimmte Aufgabe zu entwickeln. Dabei stellt ChatGPT immer wieder Fragen, die man beantwortet, um den Prompt immer weiter zu verfeinern. Das geht so lange, bis man einen Prompt erstellt hat, der dann wieder in ein neues ChatGPT Fenster kopiert werden kann, um dann eine Antwort zu bekommen. Zusammenfassung Highlights Hier der Prompt „Ich möchte, dass du mein Prompt Creator wirst. Dein Ziel ist es, mir zu helfen, den bestmöglichen Prompt für meine Bedürfnisse zu erstellen. Der Prompt wird für ChatGPT erstellt. Du wirst den folgenden…

Kommentare sind geschlossenDiese Frage wird immer wieder gerne gestellt, wenn es um nicht-technische Themen rund um das Thema geht. Besonders gerne stellen „kreative/schaffende“ Personen diese Frage, die eine natürliche Skepsis gegenüber der KI haben und Tools wie z.B. Midjourney und ChatGPT eher als Konkurrenz ansehen. Die Antwort darauf ist aber nicht so ganz einfach. Man kann sie nicht mit 100% Sicherheit beantworten und für beide Möglichekiten gibt es gute Argumente. Denn eine KI, wie sie hinter wie Midjourney und ChatGPT stehen, kann nur existierendes neu kombinieren und erschafft damit nur etwas, das eine Kombination aus etwas Existierendem ist – ist das etwas Neues? Evtl. hilft eine andere Sichtweise auf die aktuelle Situation etwas, um besser vorstellen zu können, wo wir denn heute…

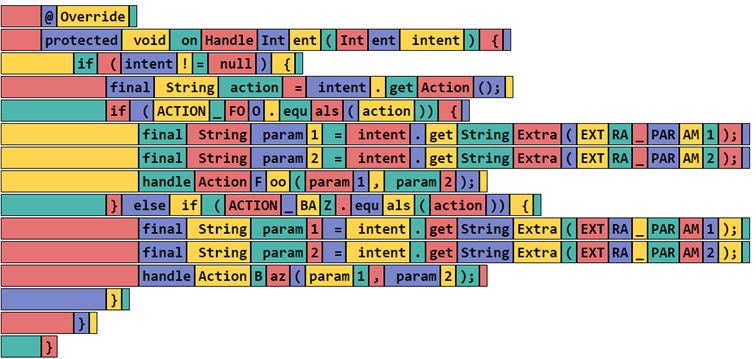

Kommentare sind geschlossenIch habe mal versucht, die DJI Ryze Tello, statt mit der App über den GameSir Controller und einer FPV-Brille zu steuern. Dabei kommt es aber leider immer zu Verzögerungen, da das Videosignal eine spürbare Latenz haben, was dazu führt, dass es kaum möglich ist die Drohne mit einer FPV-Brille zu fliegen. Um die DJI Tello trotzdem mit der FPV-Brille fliegen zu können, habe ich einfach eine kleine FPV-Kamera auf die Drohne geschnallt und bin damit geflogen. Die kleinen analogen FPV-Kameras übertragen unabhängig von dem WLAN im 5,8 GHz Frequenzbereich und haben keine (bzw. fast keine) spürbare Latenz. Den Aufsatz habe ich in OpenSCAD erstellt und auf dem 3D Drucker ausgedruckt. Hinweis: Das kleine Teil oben rechts im Bild ist ein…

Kommentare sind geschlossenDie E-Mail habe ich ja schon lange nicht mehr gesehen – und das liegt nicht daran, dass ich nicht auf mein Betriebssystem zugreifen kann. 🙂 – OK, was ist also passiert. Folgende E-Mail vom Absender Milan Savage khb10232@nifty.ne.jp hat mich am Samstagabend erreicht:

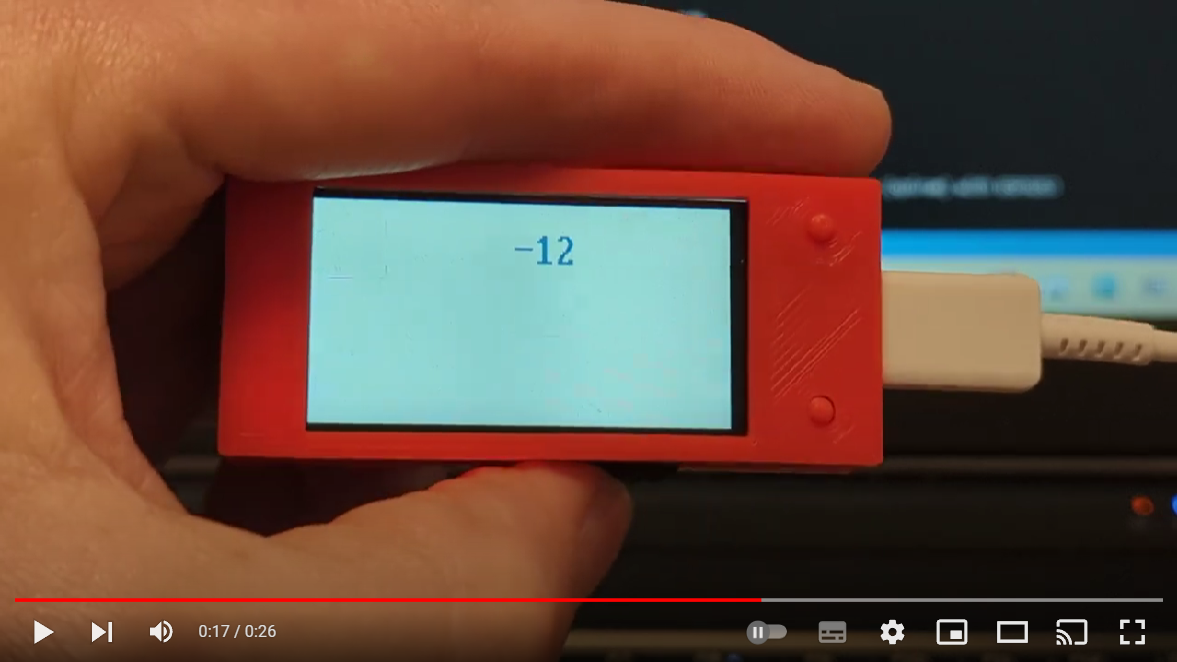

Kommentare sind geschlossenAuf dem BPI-Centi-S3 ist bei Lieferung die MicroPython Firmware „https://github.com/BPI-STEAM/BPI-Centi-S3-Doc/tree/main/micropython_st7789s3_firmware“ installiert. Diese bringt schon einige Module mit. Mit help(‚modules‘) kann man sich die Liste der Module ausgeben lassen.

Kommentare sind geschlossen